SHOWROOM、悪質コメントを検知し投稿される前にブロックする日本初のコンテンツモデレーションAI機能を搭載

SHOWROOMは、悪質コメントを検知し、投稿される前にブロックするコンテンツモデレーションAI機能を自社開発し搭載した。

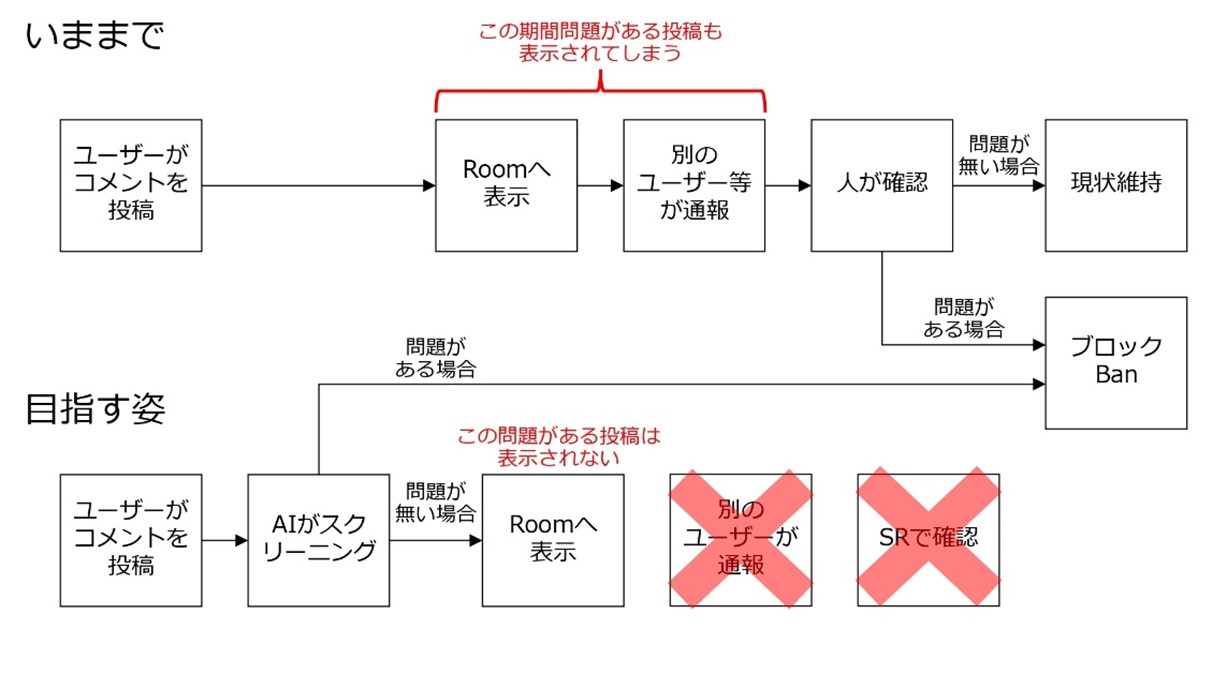

これまでは視聴者から悪質なコメントが投稿されると、別の視聴者やライバー自身が通報し、SHOWROOM監視チームがコメント確認後にブロック作業を行っていた。そのため、コメントに問題があった場合も監視チームの確認が完了するまでの間は表示された状態だった。

しかし、コンテンツモデレーションAI機能を導入することで、誹謗中傷を中心とする悪質なコメントが視聴者によって書き込まれた際、AIがスクリーニング。問題がある場合には、投稿される前に自動でブロックすることができる。そのため、不快なコメントを、ライバーはもちろん、別の視聴者が目にする機会を大幅に軽減することが可能となる。

その前段階として、AIがユーザーの代わりに通報を行う機能を実装。悪質なコメントをこれまで以上に早く確認し、投稿削除するまでのスピードを一層あげることが可能となる。今後は、精度を上げながら、自動的にユーザーの悪質投稿を表示させない機能をリリースしていく。なお、この機能については、特許を出願中とのこと。

開発を担当したSHOWROOM AI分析チーム コメント

夢をかなえるため配信に奮闘するライバーと、彼女ら彼らの配信を日々楽しみにする視聴者。「SHOWROOM」は、そんな“夢を追う人・夢をかなえてあげたいと願う人“が安心して楽しめる場所でありたいと願っています。それでも時々目にする誹謗中傷等の悪質コメント。チームとしてもこれまで徹底して発見と同時に削除に努めてまいりましたが、もぐら叩きになってしまっていたのがこれまでです。そんな中で誕生した本機能。コンテンツモデレーションの世界では、英語や中国語に対しての研究はされているものの、日本語での研究はほとんどないのが実態です。それを今回我々が開発した機能は、日本語をAIのスクリーニング機能によって事前に良質か悪質かコメントの質を見分けることが出来ます。これによって、一瞬であっても不快なコメントを目にする機会が軽減、また連鎖を防ぐことが可能になると考えます。日本語特有の遠回しな言い方や、複数回に分けてコメントをする等、従来の手法では難しかった悪質なコメントも検出することに成功。今回、無事「SHOWROOM」に第1弾が実装できることを大変うれしく思っております。

広告・取材掲載