Billboard JAPANとNTTデータグループが脳科学とAIで音楽トレンドを可視化〜NeuroAI楽曲分析プロジェクトインタビュー

NTTデータ、NTTデータ経営研究所、阪神コンテンツリンクは、NTTデータの人間の脳活動を推定する技術 NeuroAIと、阪神コンテンツリンクのBillboard JAPAN総合ソングチャートHOT 100のデータを組み合わせた共同研究を2019年9月から実施。2016年12月から2020年5月までにチャートインした2185曲を対象に、楽曲を聴いた際の推定脳活動・音色の特徴、歌詞、コード進行や過去のチャート情報等の楽曲特徴を利用し研究を行った結果、技術開発に成功し、サービスのトライアル提供を9月から開始した。資料だけではなかなか理解しづらい今回の研究について、NTTデータ経営研究所 茨木拓也氏、NTTデータ 松元理沙氏、阪神コンテンツリンク / Billboard JAPAN 植田匠人氏のお三方に話を伺った。

脳みそ分析屋さんと膨大なチャートデータが新しい世界を切り開く

──今回のプロジェクトが始まるきっかけは何だったのでしょうか?

植田:もともとBillboard JAPANの総合ソングチャートHOT 100の構成データとして「ツイート指標」というものがあるんですね。これはTwitterで曲名とアーティスト名がツイートされた数を集計している指標なのですが、そのデータ提供元がNTTデータさんなんです。

──以前からそういった関係があったわけですね。

植田:ええ。ヒットチャートをやっていると、やはり「次はなにが流行るのか?」とか「未来のヒットってなんなのだろう?」と自分たちでも自問自答するようになりますし、レコード会社やマネジメントの方からも「今後ってどうなるんですかね?」みたいな質問を受けることも多くて、やはりそういう未来のヒット予測みたいなものは需要があるんだなと思っていました。

私たちもこれまでに色々なアプローチで研究してきたことなのですが、そのなかの1つとして、「AIにヒットをしている曲をたくさん聴かせたり、膨大なチャートデータを学習させて、音楽的な分野の超優秀な仮想脳みたいなのが作れたら、将来のヒット曲を予測できるようになるんじゃないか?」といった仮説のもと、NeuroAIという脳科学のサービスをやっているNTTデータさんに企画を持ち込ませていただいて、茨木さんからも「面白そうだから、ぜひやりましょう」と言っていただき、この1年間取り組んできました。

NTTデータ 松元理沙氏

松元:NTTデータグループは、自社の脳情報通信技術 NeuroAIを活用して、広告評価サービスを提供しています。広告をみた人がどんな印象を受けるか、クリエイターの制作意図が伝わっているか、などを予測するサービスです。これは主に、広告をみた時の脳の反応を活用していますが、「音楽を聴いた時の脳の反応」を事業活用できないか?と思っていたところに、Billboardさんとの共同研究の機会をいただきました。

茨木:一言でいうと、僕ら脳みそ分析屋さんと、Billboardさんの持つ膨大なチャートデータが合わさったら、新しい世界が開けるんじゃないだろうか? ということですよね。僕らは人間が音楽を聴いたときの脳の反応を数字にする力を持っているので、それをチャートという音楽のトレンドを反映した指標と合わせればトレンドというものが可視化できて、売り上げに苦しんでいるアーティストの支援にならないか?みたいなことをビルボードさんとはお話ししました。

──なるほど。

茨木:膨大なチャートデータを持っているBillboardさん、NeuroAIの事業をやっているNTTデータ、そして、この企画とか中身の実装を担うNTTデータ経営研究所と、3社で役割分担して、この1年間やってきました。

脳を測らなくても人の脳活動を予測できるという技術=NeuroAI

NTTデータ経営研究所 茨木拓也氏

──茨木さんが所属するNTTデータ経営研究所とは、そもそもどのような事業をなさっているんですか?

茨木:NTTデータ経営研究所は経営コンサルティング会社ですが、僕自身は脳科学に関連する事業企画・開発から、研究の中身、ほぼエンジニアみたいな仕事もやっています。

──具体的にはどのような研究をなさっているんですか?

茨木:みなさんの脳には140億個くらいニューロンという神経細胞があって、これらがパチパチ発火して、いろいろな情報表現を担っています。音を聴いたり、言葉を話したりといった、世界に関する感覚の情報だったり、世界に対して筋肉でどう働きかけるかという運動の情報が皆さんの脳に表現されているんですが、僕のやっているニューロテクノロジーという技術は、そういった脳の情報をいろいろ計測することによって、「こういう脳の状態だから、この人は今、光を感じている」とか、そういうことを読み取ったりするわけです。

音楽と脳科学の関わりで言いますと、音楽を聴いていてゾクゾク気持ちいい状態のことを「Chills」というんですが、本当に感動をする音楽を聴くと背中がゾクゾクするようなときというのは、脳の中のドーパミンという物質が尾状核という領域で放出されるというのがわかっているんです。特に一番好きなフレーズを聴く直前に期待と共にどんどんと上がっていって、本当にゾクゾクするときには、また別の側坐核というところから活動するとか、結局「音楽を聴いて気持ちいい」というのは、脳で表現されているわけです。

──脳の状況を見ればわかると。

茨木:僕らの領域ですと、脳を測るだけではつまらないので、脳を刺激することによって本当に体験を変えられるのか?という考えが出てきて、最近の研究ですと、音楽を聴いて気持ちいいところの脳の領域を外部から刺激して音楽を聴くと超気持ちよくなるというのもわかったりしていて、相関を超えた因果関係までわかってきています。

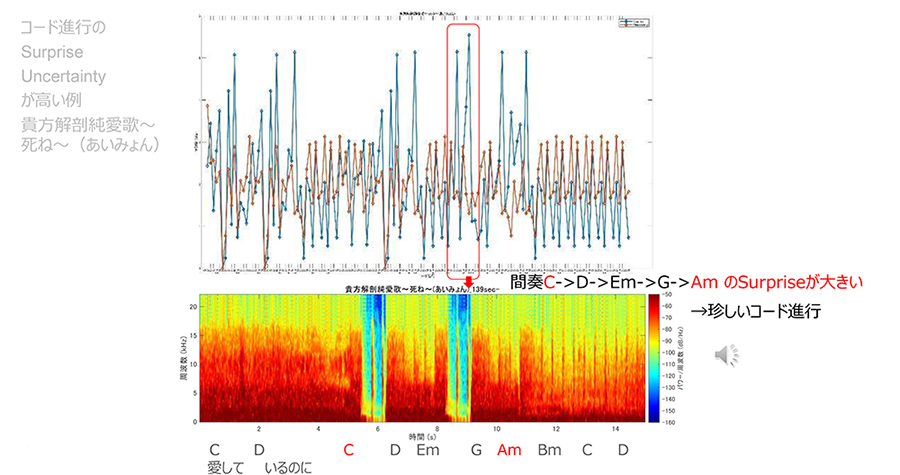

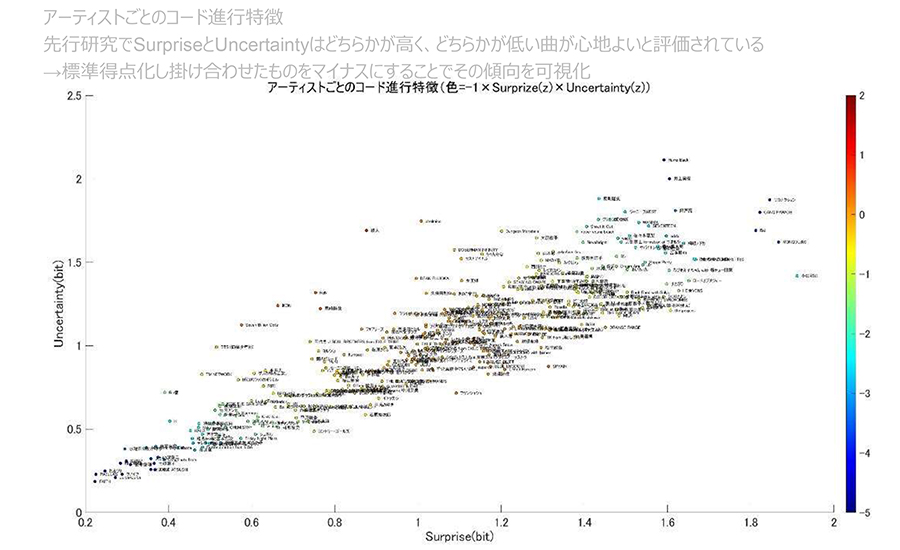

あとは最近、脳が音楽を聴いて気持ちいいだけではなくて、どんな音楽の特徴を聴けば、音の気持ちよさ、脳が感じる気持ちよさになるのかというのもいろいろとわかってきています。例えば、音色や音量、複雑さとかいろいろな音楽の特徴が脳が感じる気持ちよさに影響を与えることがわかってきています。これはアメリカのBillboardのデータを大量に分析した事例なんですが、「なにこのコード進行?!」というコード進行のサプライズや、「これはどうやってコード進行していくの?」みたいなコード進行の不確実性の指標が高い曲は、特異的な脳活動が起きて、すごく気持ちよく感じるということが、2020年の先行研究の段階ではわかっていたんです。

──それは面白いですね。

茨木:僕たちが作っているNeuroAIの技術というのは、もともと音楽ではなくて映像、音と画像の領域を想定していまして、例えば、人間をMRIというスキャナーの中に入れて映像を観てもらったら、脳活動を見るだけで、その人が何を見てるかというのは、ある程度のレベルでわかったりします。女性がメインで出ている映像だとか。これはデコーディングといって体験を脳から読み出すという技術なんです。

──例えば、どんな夢を見ているのかも分かったりするわけですか?

茨木:夢もいけます。寝ているあいだに脳をスキャンさせてもらえれば、夢で何を見ているかというのもわかります。全部脳で表現されているので。僕らはこの技術をビジネスに使おうというのが仕事です。つまり広告、特に動画の広告のクリエイティブを脳の反応から定量化しましょうということで、映像を観てもらって、そのときの脳活動を定量的にとりだして、「こういう脳活動を起こしたときにはうまくいっている」「うまくいっていない」みたいなことを事業としてやっています。

──そこはコンサルっぽいですね。

茨木:ただ、このやり方ですとMRIを買うのに4憶円ぐらいかかる上に、あまりにも時間がかかりすぎて広告業界に適用できなかったので、僕らはこのデータを大量に取り貯めて、「こういう映像と音声を聴いたら脳がこういう活動をする」ということを予測できるようなモデルを作ったんです。これを仮想脳と言うんですが、ようするに脳を測らなくても人の脳活動を予測できるという技術、これがNeuroAIというものになります。つまり、AIとか機械学習という、コンピューターだけでやるのではなくて、人間の脳の情報を使ったほうが、より人間の行動は予測できますよ、というのを研究しているわけですね。そもそもコンピューターだけのAIって味気ないじゃないですか。

──確かに(笑)。

茨木:僕らは、人間の脳にこそ一番自然な情報処理があるはずだと考えているわけです。それでBillboardさんのデータを使って、NeuroAIのミュージックバージョンを作ろうというのが今回のプロジェクトです。

脳の中の潜在的な音楽の特徴を把握する

──どのような作業から着手されたんでしょうか?

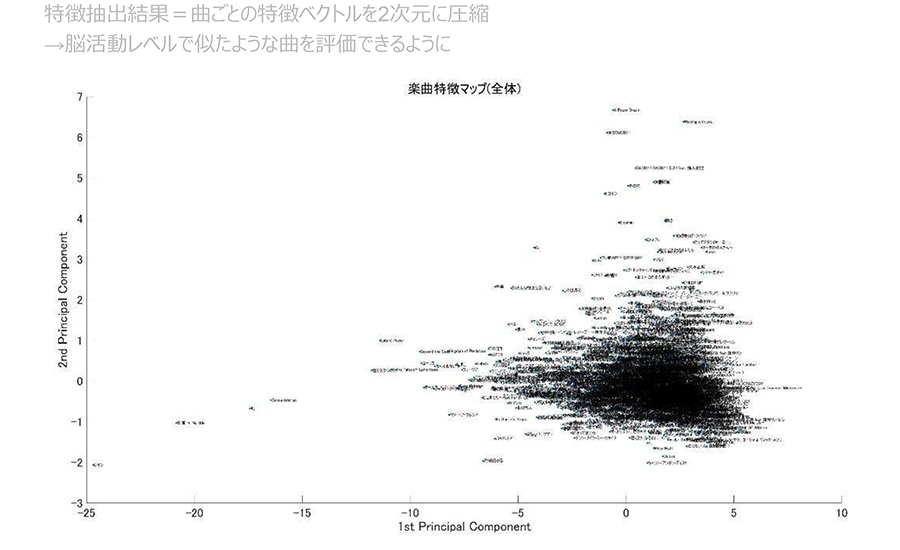

茨木:まず最初に、どんな音を聴いたときに脳がどういう活動をするかというのをNeuroAIで特徴抽出をしていきました。あと技術的には細かいんですが、脳の情報だけだと全ての音楽の波長をとらえられないので、他にもいろいろな方法を使っていて、その1つがMFCCと言って、音の周波数の特徴を数字にするという技術です。これは音楽の中でどんな周波数のものがどのくらい含まれているか、というようなものです。あとは歌詞ですね。歌詞というのも大事なので、言葉というのを特徴にするために、このWord2Vecという言葉を数字に変換するという技術を使っています。簡単に言うと「男」と「女」というのを数字にしちゃうんです。そうすると「男-女」っていうのを計算できるようになって、「男-女」に「叔父」に足すと「叔母」になるみたいな。そんな数字が使えるようになるのがword2vecなんですが、これで歌詞を全部数字にしていきました。あとはコード進行も数式にまとめました。

──とにかく音楽の持つあらゆる要素を数値化・数式化していったんですね。

茨木:ええ。この研究の段階では確か700曲ぐらいコード進行を取ってきて、例えば、Bフラットのあとに、Bフラットが来る確率というのは、その中で何パーセントか、みたいなものを分析していったときに、それがレアであれば1つ目の指標のサプライズが起こりえる確率を数値化したり、もう1つの不確実性は、例えば、Bフラット→Bフラットって、多くの人が使うけど、だからこそそのあとにFにいったり、Cにいったり、Eマイナーにいったりというのは非常にたくさんのバリエーションがあると、Bフラット→Bフラットと聴いたときに、聴いているほうはどこにいくかわからないじゃないですか。これは言葉にするのは難しいんですが、みなさんが音楽を聴いているときに脳が無意識にやっている計算を数値化したものがこの不確実性というやつです。

──例えば、珍しいコード進行をすると「気持ち悪い」という反応も当然あるわけですよね?

茨木:そうですね。過去の研究でわかっていたのは、この「不確実性が高いんだけどサプライズは低い」というパターンと、「サプライズは高いんだけど不確実性は低い」という組み合わせじゃないと気持ち良くないみたいなことがわかっていました。つまりバランスが重要なんですね。

──例えば、和声として間違った展開だったりとか?

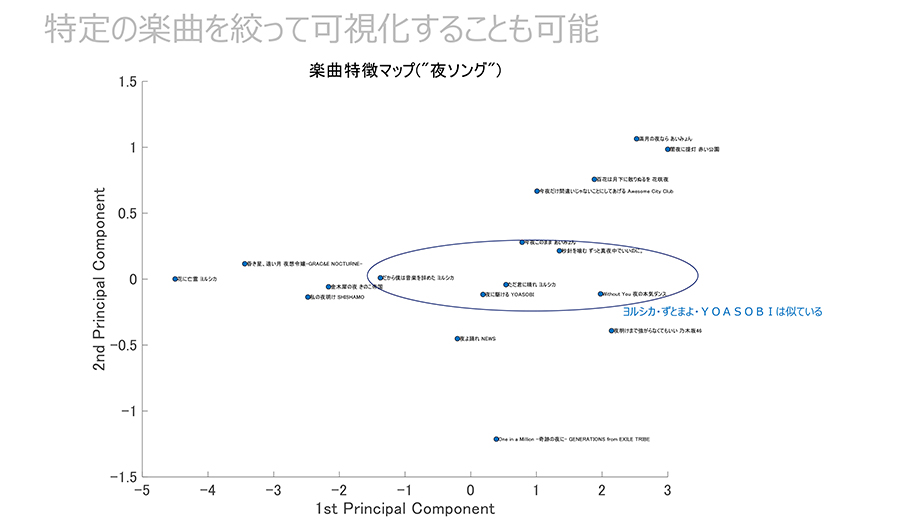

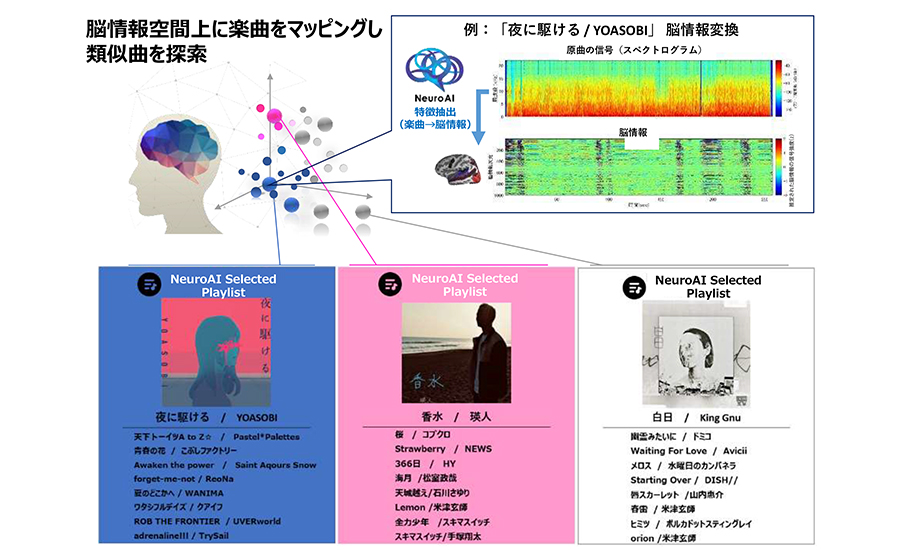

茨木:そういうのもあるかもしれません。とにかく曲を聴いたときの脳の反応、音色、歌詞、そしてコード進行というのを全部数字にするので、1曲あたり、数字の羅列、ベクトルと言うんですがそれができて、それを無理やり2次元上にマップ化したものが、この特徴マップで、例えば、「夜」という言葉が含まれている楽曲だけで見てみると、ヨルシカとかYOASOBIというのは近いところにいたりします。

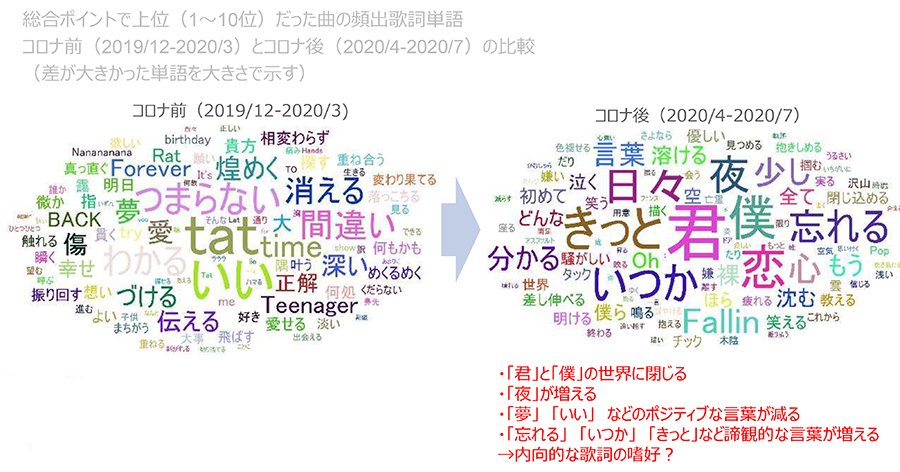

茨木:あと歌詞に関して言いますと、例えば、コロナ前後で歌詞がどう変わるのか? みたいなことも分析できて、コロナ前だとこういう単語が多いんだけど、コロナになるとこういう単語が増えてくる、みたいなのが特徴として見えてきたりもするんですが、なんか「夜」が増えるんですよ。

──これ、面白いですね。

茨木:あとはコード進行の特徴で、サプライズと不確実性というお話をしましたが、アーティスト毎に曲でどのくらいサプライズと不確実性があるのかをまとめたものもありまして、サプライズ、不確実性が高い曲の例で言うと、あいみょんさんの『貴方解剖純愛歌』という曲がそうです。

茨木:多分、あいみょんさんってイメージとしてはすごくジェネラルなコードを使うイメージだと思うんですが、実はジェネラルだからこそ、他の人が使わない展開というのに対応しているアーティストでした。逆に、椎名林檎さんの『丸の内サディスティック』という曲なんですが、これは逆にものすごくサプライズや不確実性が低い、これは他の人があまり使っていないようなコードなので、ユニークとも解釈できます。

──他の人があまり使わないコードだから、逆にサプライズや不確実性の数値が高くならない?

茨木:そもそも他の人が全然使わないコードなので、驚けないというか、独特ということですよね。この辺が結構アーティストごとに個性があるようなところです。で、定量的にできたので、例えば、このYOASOBIさんの『夜に駆ける』という曲を脳情報化すると、どのような脳活動が4分間で起きるというのがわかるので、それを数値化すると、その曲の類似性、脳活動の類似性というのが評価できて、プレイリストが作れるようになったのが一つ目にできたことですね。このプレイリストを聴いてみますと、意外なものもあるんですが、聴いてみると納得するみたいな感じになっています。

植田:これで全く新しい音楽の特徴というのが出せるんですよね。例えばR&Bやジャズ、ポップスやロックとか、そういうのって時代性や批評の文脈によって成り立つ音楽ジャンルじゃないですか? あとは「なんかこの曲格好いいな」とか「切ないな」とか「元気をもらえるな」というのも、人それぞれの主観の特徴です。そういうものではなくて、脳の中の潜在的な音楽の特徴がわかるようになるわけです。

音楽のジャンルとか出自が似ている人たちが集められたプレイリストは多分世の中にいっぱいあると思うんですが、そうじゃなくてNeuroAIから抽出した音楽特徴が似ている曲というのでプレイリストを作ると、例えば、最近すごく流行っている、瑛人さんの『香水』の次に続くのがコブクロさんの『桜』だったりして、聴いてみれば確かに「似た刺激を受けるかも」みたいな納得感は個人的にありました。

──似ているのとはまたちょっと違った「確かに」って思いが生まれますね。

植田:あと、意外性が大きい曲で言うと、石川さゆりさんの『天城越え』や米津玄師さんの『Lemon』とか。もちろん人それぞれ納得感には差があると思いますが、あくまで脳情報によって定量化された音楽特徴で作られたプレイリストで、個人の趣味嗜好は反映されていないので、そういう意味では今まで自分が聴いてこなかったようなタイプの音楽からお気に入りに出会えるかもしれない。今までにあるような関連動画やレコメンドって、ユーザーアクティビティが主なアルゴリズムじゃないですか?

茨木:行動しないとわからないというね。

植田:Spotifyでこういう曲をたくさん聴いていたから、それと似通ったジャンル、あるいはそれと同じような音楽を聴いたユーザーが別で聴いているような曲というのをレコメンドされるんじゃなくて、全く未知のところからやってくる感覚はあると思います。

「AIが決める時代」ではなく、あくまでも天気予報

──この技術の活用法についてはどう考えていらっしゃいますか?

植田:まだ研究の第一弾なんですが、先ほど言ったようにプレイリストやレコメンドのアルゴリズムに応用ができると思っていますし、これにチャートデータを紐づけることによって、脳情報的な視点で、こういう刺激、特徴を持った曲が今流行っている、これまで流行ってきた、というのがチャートから見えるじゃないですか。そのパターンの時系列変化をディープラーニングさせることで、未来にどういう音楽特徴を持った曲がチャートで上位に入るかというのを予測するんですね。それが現在、4か月くらい先までであれば高い精度で予測できるようになったんです。この成果はアーティストや音楽を商材としているレコード会社やマネジメントにも役立てていただけるのかなと考えています。

──それはニーズがありそうですね。

植田:あとはもともとNeuroAI が広告の評価サービスとして活用されていた技術なので、「どんなCMソングとタイアップすれば、この広告のパフォーマンスを最大化することできるか」といったような課題の解決もサポートできるかもしれないです。

──例えば、ミュージシャンだとして、AIに自分の作っている曲を聴かせると、売れるかどうか判断してくれるみたいなこともできてしまう?

植田:例えば、レーベルってアーティストとやりとりをしていくなかで「じゃあ、次にリリースする曲はどれにしようか」って話し合いがあるじゃないですか。「今、こういう曲があるんですが、こういう曲もあって」と、例えば3曲くらい候補があったなかで、このNeuroAI-Musicにそれらの曲を評価させることで、今後のトレンドに最もマッチする音楽特徴を持つのはどの曲か?という、一つの物差しのように活用してもらえるサービスになればいいなと思ってます。

──ここまでできちゃうということは、音楽に限らずなんでもできちゃうわけですよね。

茨木:ええ。僕らはそれをずっと広告とかでやっていたので。

──例えば、面接のときの映像をAIに読み込ませて「この人は大体ここらへんまで出世するだろう」みたいなことも、わかっちゃう?

茨木:それは難しくて、未来にどんな仕事のスキルを求められる人が活躍するかわからないですから、そういうのは無理だと思います。

植田:今回の研究で言うと、その情報を補填するのがチャートデータなんです。例えば、今おっしゃったように、就職のチャートデータみたいなのがあれば、もしかしたらそれもできるかもしれない。

茨木:でも、そんな先のことまで決定論的にAIになんか決められたら人生つまんなくないですか?

一堂:(笑)。

松元:あくまでも、今までの音楽のトレンドを脳情報で捉えた結果、今後どうなるか?という予測なので、確実というわけでもないんです。

植田:この話で誤解をしてほしくない部分は「AIが決める時代」というのには決してならないということなんですよね。僕らはあくまでサポートをする、選択肢を増やすだけで。ですから例えば、クリエイターが「今はOfficial髭男dismが流行っているから、ヒゲダンみたいな曲を書いて欲しい」みたいな発注を受けることってあると思うんですけど、そういう結果論的なヒット分析ではなく、形式的な音楽ジャンルにもとらわれないヒットソングの作り方もあるはずだということを僕らは提示したいんです。

──昔から「ヒゲダン風」とか譜面に書いてるディレクターとかはたくさんいましたよ。

植田:やっぱりありますよね。

──だから、抵抗はないと思いますよ。人間がイメージだけで言ってきたことを、それをデータが証明してくれるんだったら、わりかし取り入れちゃうと思いますよ。

茨木:僕はちょっとした天気予報ぐらいだと思っていて、別に雨だろうと出かける人は出かけるし、いいんじゃない?と。でも天気予報があったら便利だしということなんですよ。今、予測と言っちゃいましたが、例えば台風がフィリピンからきていて、それが「多分、北上してきますよね」ということができますぐらいのことを僕らは予測と言ったんです。そのぐらいのレベルですから、次にいつどんな台風が来るかはわからない。

──右に行くか、左にずれるか。

茨木:そのぐらいは統計データからパターンでわかるんです。

サブスク時代の新しい楽曲の勧め方

──さきほど聴かせていただいたプレイリストで、Aviciiは元々好きで、その後に流れた『白日』も結構好きだったんですね。まあ、どちらも売れていたし、やっぱり売れる曲って多くの人たちに受け入れられるのかな?と思っていたんですが、今日の説明を聞いて、なるほど、この2曲は自分のパターンに合ってるから好きになったんだな、と感じました。他の曲は知らなかったんですが、今聴かせてもらってみたら結構好きでした。自分のパターンに当てはまってるからなのでしょうね。

松元:2曲目は、ドミコという2ピースのバンドのアルバムからの曲ですね。こういう風にプレイリストに出てくると、シングル曲以外でも聴かれる機会が増えるのではと思います。

植田:そこはストリーミングの時代にすごく合っていると思いますね。ヒゲダンの昔のアルバムの曲が今、映画の主題歌になっていたりするような時代で、そういう時代にある意味寄り添っているとは思います。僕らのチャートの設計思想がもともと「シングルチャート」ではなく「ソングチャート」なので、それを元データにしている意味でもやっぱり、未知の曲との出会いというのが期待できる技術になっているかなと思います。

──いわゆるロングテールの考え方ですよね。新譜だけでなくて、過去の音楽も掘り起こされることになると、レコード会社や楽曲を作っている人たちにもいろいろなチャンスがあるとすごく思いますね。

植田:そうですね。さきほどリリース曲のサポートと言いましたが、過去のカタログからもしかしたらヒットすることもできるかもしれないですね。

──サブスクのすごいのはそこですよね。新譜が絶対ではなく、新しいかどうかは別にどうでもいいわけで、どれを新譜にするのかは自分次第みたいなところがでてきたわけですよね。過去の膨大なアーカイブの中から、好きなものを見つけてくるだけで。

茨木:面白いですよね。確かにビルボードのチャートはそうなんですよね。チャート分析をしていると、古い曲がガンガン出てきますから。

植田:大阪の有名な高校ダンス部が、荻野目洋子さんの曲を使って、突然チャートを上がってきて、メディアの方から「間違ってませんか?」みたいな問い合わせを受けたり。(笑)。「すごく昔の曲なのに、なんでチャートに入ってきたんですか?」って。

つまり曲の鮮度とか、形式的な音楽ジャンルでは、もう音楽のヒットは分析しきれない時代だと思うんですよね。そういう意味で、全く新しい音楽分析の視点というのが欲しかったというところで、この研究に繋がっていくというのがあります。

アーティストパワーを除いたチャートとは

──チャート予測についてもお伺いしたいのですが。

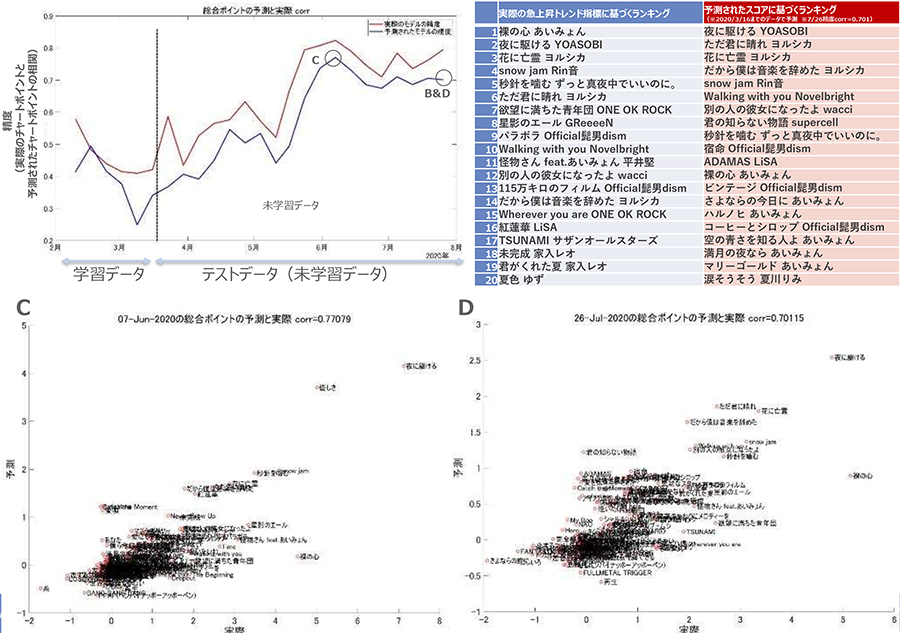

茨木:チャート予測をする上で、チャートデータを実際に使って、これを分析していくというのをやっていったんですが、Billboardのチャートデータってすごくいいデータなんです。やっぱりデータの種類が多いですね。その中で、トレンドという意味では、全く今まで聴かれていなかった曲が、加速度的に0が急に10ぐらいになったものを見つけたいなと思って、そういう人たちを評価する「急上昇トレンド指標」というものを作りました。

その「急上昇トレンド指標」で分析をしていくと、例えばYOASOBIとかも新しく指標化すれば、実際のポイントの一か月くらい前からとか取れます。実際のトップ20に入ってくるのはその3か月後なんですが、3か月前にチャートの分析ができて、こういうデータも使えるようになりました。

で、トレンドを予測したいというときに、どういう基本的な考え方かというと、年数が経っていくときに、あるときはこういう曲特徴を持っているのがチャートの上位に来ていたと。でもそれが廃れていき、次はまた別の特徴が支持されてまた廃れていくだろうと。こういう流れというのがあるのかないのか、あったとしたらこの流れを予測できないか?ということをやってきまして、実際に使ったのは、毎週ランクインしているチャートデータと、そのときの脳活動と、他の情報を使って、それをその週のランクインする特徴はどんなものかというのを分析する式というのを作っていたんです。

式と言っても全然難しくなくて、普通に高校でやるような「y=ax+b」みたいな数式と全く同じで、これはyがその週のチャートデータで、axのxが曲の特徴なんです。そのときにaというのが入ることによって、ある特徴のやつは、たとえばaが2だったら、その特徴を持っていたら2倍になるみたいな。それが-1だったらそれを持っていたらランクが下がると。それを毎週毎週作っていくんです。

今回はそれを195週分ぐらい学習させていて、モデルの精度としてもボチボチ良くはなっていって、例えば、7月20日週のチャートなんですが、これが実際のビルボードのチャートデータと、その式を作って予測したポイントを比較して、完ぺきに予測できていたら、これがきれいに直線状になっていく、1つ1つが曲になるんですけれど。

──でも、大きくは外してないですよね。

茨木:そうですね。1曲1曲に特徴があるわけですが、どの特徴の曲がこの週は売れているみたいなのが、毎週見えてくるので、僕らのアイデアとしては、週ごとに「こういう特徴の曲が売れている」というこの時系列の変化を予測できないか?ということで、それをやりました。実際には機械に「こういうパターンでこれまできた」というのを学習させて、見せていないデータを当てさせるんですね。そうすると、完ぺきには当たらないんですが、そこそこ未来のことも予測できるようになっています。

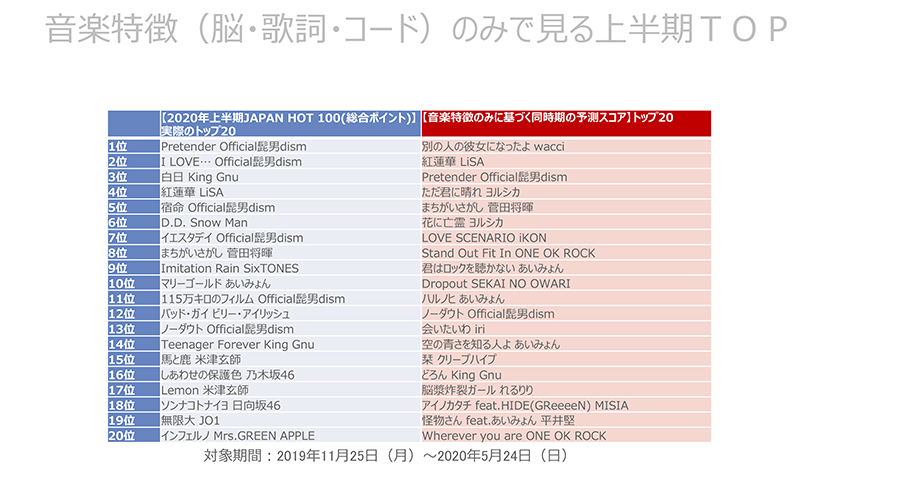

その式を使うとなにが面白いのかと言いますと、式の中に含まれているデータというのが、脳情報と歌詞とコード進行の特徴に加えて、前の週までのチャートのデータというのも入れていったんです。そうすると、たとえば嵐とかもともとすごいパワーを持っている人たちって、そのパワーだけでもある程度は売れるじゃないですか? その人たちのもともとのパワーみたいなものをここで弾いてしまって、そもそも曲特徴だけでどれだけ勝負できているのか?というところだけを取り出すことができるんです。

──アーティストパワーを除いた、単純に曲の力だけのチャートが組めると。

植田:その楽曲の特徴だけで作り直した2020年上半期ランキングというのが、下記になります。

──これは大変興味深いですね。

茨木:まあ、未来予測とか言うんですが、実際のチャートで見たって難しいなというのが感想です。ただ、さきほど言いました、急上昇トレンド指標という、新しいアーティストが出てくるという指標だけ精度がすごく高いので、ここを切り取ってプレスリリースには書いたんです。ようするに実際のチャートではなくて、急に上がってきた人たちというのに関しては、4か月経っても予測できていて、精度としては実際と予測のあいだはきちんと揃っているんです。

──いろいろな影響を受けない無名の人であれば、予測しやすいということですか?

茨木:いや、そんなに無名でもないとは思うんですけれどね。

──ベクトルがはっきりしているからですかね。

茨木:ただ、今のところ「前の週にあなたは何ポイント持っていましたか?」みたいなデータがないとここまでの精度は出ないというのはあります。一応、音楽の特徴だけで、3か月後の10月にどんな曲が来るのかみたいなことも一応出すことはできて、このアーティストのこの曲が持っている特徴に似ている曲というのが支持されるだろうみたいなものは、予測しています。だけどこれは大分粗いと思います。さっきの台風予測と同じぐらいなので。

──やはり曲特徴というのが肝ですよね。例えば、季節性などはどうなんでしょう? クリスマス近くにになると、山下達郎が入ってくるとか。

茨木:ちょっとわからないですね。どうなんだろうなあ、季節性は…。ひょっとしたら3年分のデータの中でクリスマスに挙がるのを学習できていたら、12月の時期にはあるかもしれないけど、そこまでは多分できないと思います。

植田:実際のチャートには出てくるんですけどね。3月9日になればレミオロメンさんの「3月9日」がチャートを上がってくる、みたいな。でも、この予測モデルはそういうのを省いて、楽曲の特徴だけですからね。

──ということはやっぱり曲を作って制作して売る側にはありがたいデータということですよね。

茨木:僕は、本当に台風が出てきていて「こうなりそうだ」というのを見た上で、自分たちのアーティストをどうするか? という判断材料としての、天気予報ぐらいの価値だと考えています。無くても生きてはいけるけど、それを参考にしたらより確実にみたいなことです。

NeuroAIによる楽曲分析プロジェクトの可能性

阪神コンテンツリンク / Billboard JAPAN 植田匠人氏

──このデータをビルボードチャートの中に生かしていく予定はないんですか?

植田:その予定は今のところないですね。チャートはあくまでチャートとして、このまま世相を写していくだけなので。ただ、2018年にGetty ImagesがNeuroAIを使って「今年の写真1枚」を選ばせたように、同じようなことの音楽版があっても面白いなと思っています。「今年の1年を象徴する1曲」みたいな。

茨木:もともとのアーティストパワーを抜いてあげてね。

植田:全然誰も知らないような1曲が選ばれるかもしれない。

茨木:チャート情報というか、トレンドの文化発信みたいなところもあるかもしれないですよね。ヤフーの天気予報みたいなので曲の予想が4週目ぐらいまで出せるようになるかもしれない。でも未来のことは本当にわからないですね。これはあくまで天気予報みたいなものなので。アーティストが急死して曲がチャートにあがるとか、そんなのは一切予測できないので。

──でも、選曲をしなきゃいけない人たちにとって、すごくいいデータですよね。ラジオのディスクジョッキーとかCM音楽とかもそうですし。

植田:僕らもこのデータ、そして、この研究の見せ方みたいなのをいくつか考えています。例えば、ビートルズの楽曲をNeuroAIに2020年のトレンドを加味して評価してもらって、ベスト盤を作ったら、世の中的にはあまり知られていない曲が、1曲目にきたりするかもしれない。その意外性みたいなものも面白いですし、あと弊社が運営しているビルボードライブのCMソングとして作った音楽をいくつか用意して、その中から「この中でCMソングとして一番優秀なもの」をAIに選んでもらう。そうすることで、お客さんに与える影響というのがあるのかどうか?という、技術のユースケースを想定した実験をこれからやろうかと考えています。

松元:実際にテレビCMでは、クリエイティブは変えないけど、曲だけ変えて流し直すという企業様もいらっしゃるので、そういった際にクリエイティブと音楽のマッチングをNeuroAIで支援していきたいと思っています。

──個人的には大変興味のある話で、すごく面白かったですが、やはり、業界も含め理解を得るのと周知するのは必要になってきますよね。

植田:ええ。僕らとしても、今後この研究を周知させていって、どういうニーズがあるのか?というのを探りつつ、並行して精度を高めていきながら、サービス化を目指していきます。今回この研究の第一弾を発表できましたので、今後、新しく組んで、一緒に新しいサービスを作っていけるプレイヤーも見つけられたらいいなと思っています。

──やはり、サブスクとかと一緒にやったりするのが一番イメージがつきやすいですよね。

植田:そうなんですよね。サービスの裏側で音源データをNeuroAI-Musicにひたすら学習させて、アルゴリズムの構築に役立たせてもらえたりしたらいいなと思っています。

茨木:僕らは音楽業界にないものを作っている自覚はあるんです。あとは僕らも何かの役に立てればいいですが、何の役に立てるかわからないから、とりあえず世に出したいと(笑)。

植田:いろいろな可能性は感じていますので、興味を持たれたら是非気軽にお声がけいただきたいですね。

Billboard Japan × NTTデータ NeuroAIによる楽曲分析プロジェクト資料前半(PDF)

Billboard Japan × NTTデータ NeuroAIによる楽曲分析プロジェクト資料後半(PDF)

広告・取材掲載